仕組み

- W&B Run を作成します。

- 学習率やモデルのタイプなどのハイパーパラメーターを辞書として設定 (

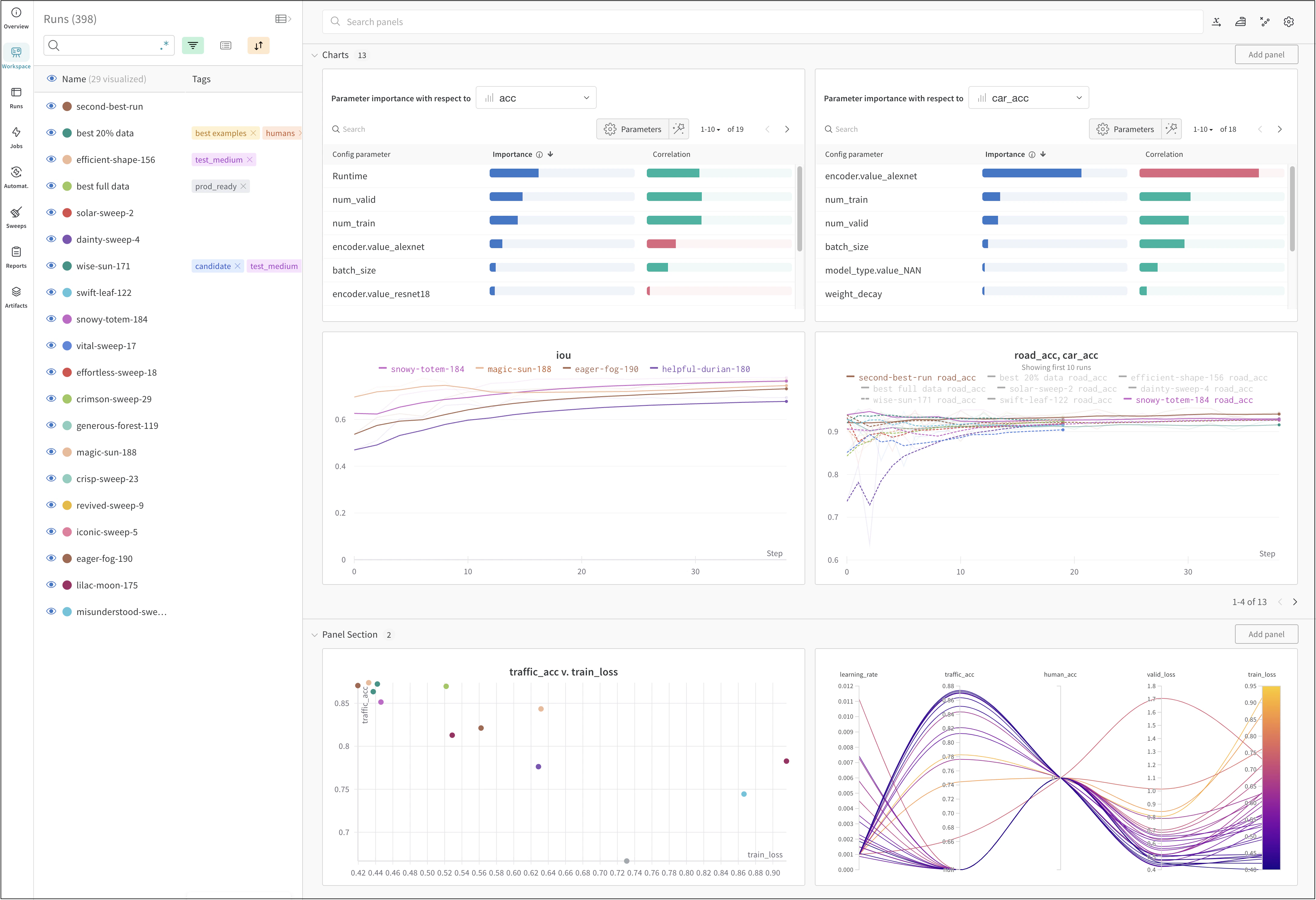

wandb.Run.config) に保存します。 - 精度や損失などのメトリクスを、トレーニングループの中で継続的にログします (

wandb.Run.log()) 。 - モデルの重みや予測結果の表など、run の出力を保存します。

はじめに

- データセット artifact を作成し、トラッキングして、使用するために使える W&B Python SDK のコマンドを step ごとに説明した W&B クイックスタート をお読みください。

- この章では、次の方法を学べます。

- 実験 を作成する

- 実験 を設定する

- 実験 からデータをログする

- 実験 の結果を確認する

- W&B API Reference Guide の W&B Python Library もご覧ください。